英偉達CEO黃仁勛在一次公開演講中提出了一個引人深思的觀點:未來的軟件將主要由人工智能(AI)監(jiān)督機器人自動編寫,人類開發(fā)者的角色將更多轉(zhuǎn)向設(shè)計、審核與戰(zhàn)略規(guī)劃。這一設(shè)想迅速在科技界引發(fā)熱議,其中特斯拉與SpaceX的CEO埃隆·馬斯克在社交媒體上幽默回應(yīng):“看來即使AI也逃不過中間管理層。”這句調(diào)侃不僅增添了討論的趣味,更折射出人工智能在應(yīng)用軟件開發(fā)領(lǐng)域引發(fā)的深刻變革與挑戰(zhàn)。

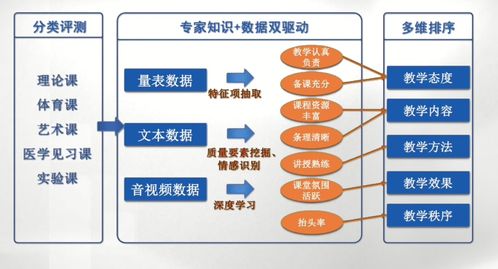

黃仁勛的預(yù)言基于AI技術(shù)的飛速發(fā)展,尤其是生成式AI和自動化編程工具的成熟。他認為,未來的軟件開發(fā)流程中,AI將能夠理解自然語言描述的需求,自動生成高效、可靠的代碼,并通過機器學(xué)習(xí)不斷優(yōu)化。而人類工程師則扮演“監(jiān)督者”角色,負責(zé)設(shè)定目標、確保代碼符合倫理與安全標準,并處理復(fù)雜系統(tǒng)集成等高層任務(wù)。這種模式有望大幅提升開發(fā)效率,降低人力成本,并減少人為錯誤,特別是在重復(fù)性編碼任務(wù)中。

馬斯克的幽默回應(yīng)觸及了一個關(guān)鍵問題:如果AI主導(dǎo)編程,是否也會催生新的“官僚層級”?在傳統(tǒng)軟件開發(fā)中,中間管理層常負責(zé)協(xié)調(diào)、監(jiān)督與資源分配;而在AI驅(qū)動的類似的監(jiān)督機制可能以算法形式存在,例如AI系統(tǒng)需要多層驗證、決策流程或倫理審查模塊。這暗示著,即使技術(shù)高度自動化,軟件開發(fā)仍可能保留一定的層級結(jié)構(gòu),只是從人類轉(zhuǎn)向了機器智能的“自我管理”。這種變化既可能帶來效率提升,也可能引發(fā)對透明度、可控性的新?lián)鷳n。

從應(yīng)用軟件開發(fā)的實際場景來看,AI的介入已初見端倪。當(dāng)前,低代碼平臺和AI輔助編程工具(如GitHub Copilot)正逐步普及,它們能根據(jù)上下文提示自動生成代碼片段,幫助開發(fā)者快速完成基礎(chǔ)工作。黃仁勛所設(shè)想的“AI監(jiān)督機器人”則是這一趨勢的延伸:AI可能不僅生成代碼,還能自主測試、調(diào)試甚至部署軟件,形成端到端的自動化開發(fā)管道。這意味著更快的產(chǎn)品迭代周期和更靈活的響應(yīng)能力;但對開發(fā)者而言,也要求技能轉(zhuǎn)型,從編碼轉(zhuǎn)向更側(cè)重創(chuàng)意、架構(gòu)設(shè)計與AI系統(tǒng)治理。

值得注意的是,這一未來并非沒有挑戰(zhàn)。安全性問題凸顯:如果軟件完全由AI編寫,如何確保它沒有隱藏漏洞或被惡意操控?倫理與偏見風(fēng)險:AI的訓(xùn)練數(shù)據(jù)可能包含社會偏見,導(dǎo)致生成的代碼隱含歧視性邏輯。馬斯克提到的“中間管理層”幽默背后,實際指向了AI決策的可解釋性難題——當(dāng)AI監(jiān)督AI時,人類如何理解并干預(yù)其決策過程?這些都需要行業(yè)在技術(shù)標準、法規(guī)框架上未雨綢繆。

黃仁勛與馬斯克的對話勾勒出人工智能在應(yīng)用軟件開發(fā)中的雙面圖景:一方面,自動化將解放人力,推動創(chuàng)新進入新階段;另一方面,它也將重塑工作流程,并帶來管理、倫理上的新課題。對于開發(fā)者和企業(yè),擁抱AI工具的培養(yǎng)跨領(lǐng)域技能、建立人機協(xié)作的治理體系,將是應(yīng)對未來的關(guān)鍵。正如馬斯克所調(diào)侃的,或許在AI的世界里,“管理”不再是人類專屬,但如何讓這種管理更高效、更公平,依然需要我們深思熟慮。